# Ein benutzerdefiniertes KI-Modell hinzufügen

##  Übersicht

Dieser Artikel erklärt, wie Sie ein benutzerdefiniertes KI-Modell mit DevOps verbinden und dabei Flosums gemeinsam genutzte KI-Ressourcen ersetzen. Die Verwendung Ihres eigenen Modells kann die Leistung verbessern, die Latenz verringern und dazu beitragen, vorübergehende Fehler zu vermeiden, die durch hohe Auslastung von Flosums gemeinsam genutzten KI-Ressourcen verursacht werden. Ein selbst gehostetes Modell kann außerdem eine stärkere Informationssicherheit bieten als Cloud-KI-Anbieter. Abhängig vom Anbieter und dem von Ihnen gewählten Modell können Sie Verbesserungen bei Geschwindigkeit und Zuverlässigkeit feststellen. Zum Verbinden benötigen Sie ein API-Token von Ihrem gewählten Anbieter. Weitere Informationen zu den KI-Funktionen in DevOps finden Sie im folgenden Artikel.

* [ubersicht-uber-ki-funktionen](https://docs.flosum.com/devops/devops-de/einstellungen/ki-einstellungen/ubersicht-uber-ki-funktionen "mention")

{% hint style="info" %}

#### Best Practices

* Validieren Sie Ihre Konfiguration für das benutzerdefinierte KI-Modell in einem Nicht-Produktions-Branch, bevor Sie sie breiter ausrollen.

* Verwenden Sie einen API-Endpunkt eines KI-Modellanbieters, der Ihren Sicherheitsanforderungen entspricht (Cloud vs. selbst gehostet).

* Speichern Sie Ihr API-Token sicher und rotieren Sie es gemäß Ihren Sicherheitsanforderungen.

{% endhint %}

### Unterstützte KI-Modelle

## Hinzufügen eines benutzerdefinierten Modells

{% stepper %}

{% step %}

### Benutzerdefiniertes Modell aufrufen

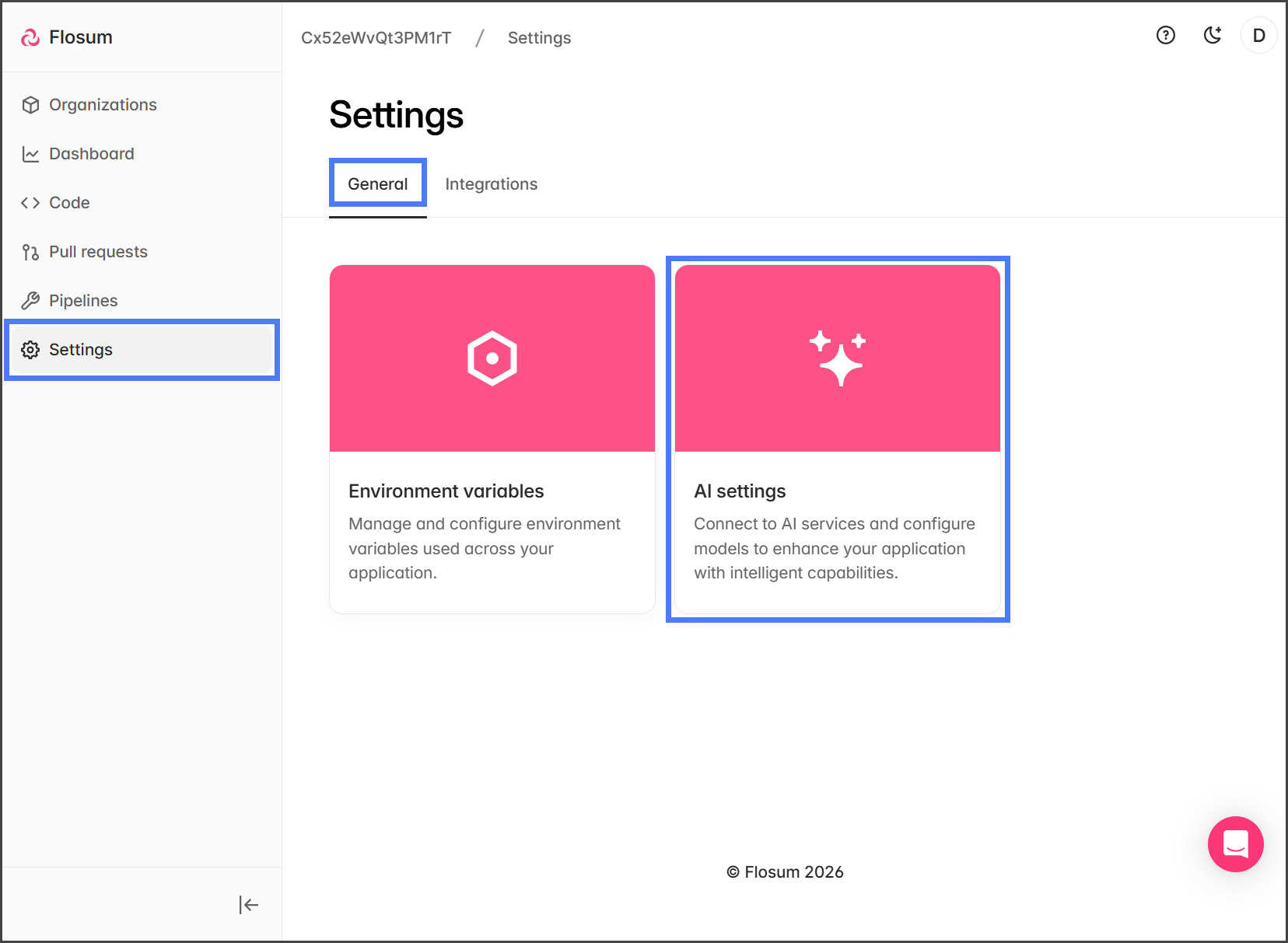

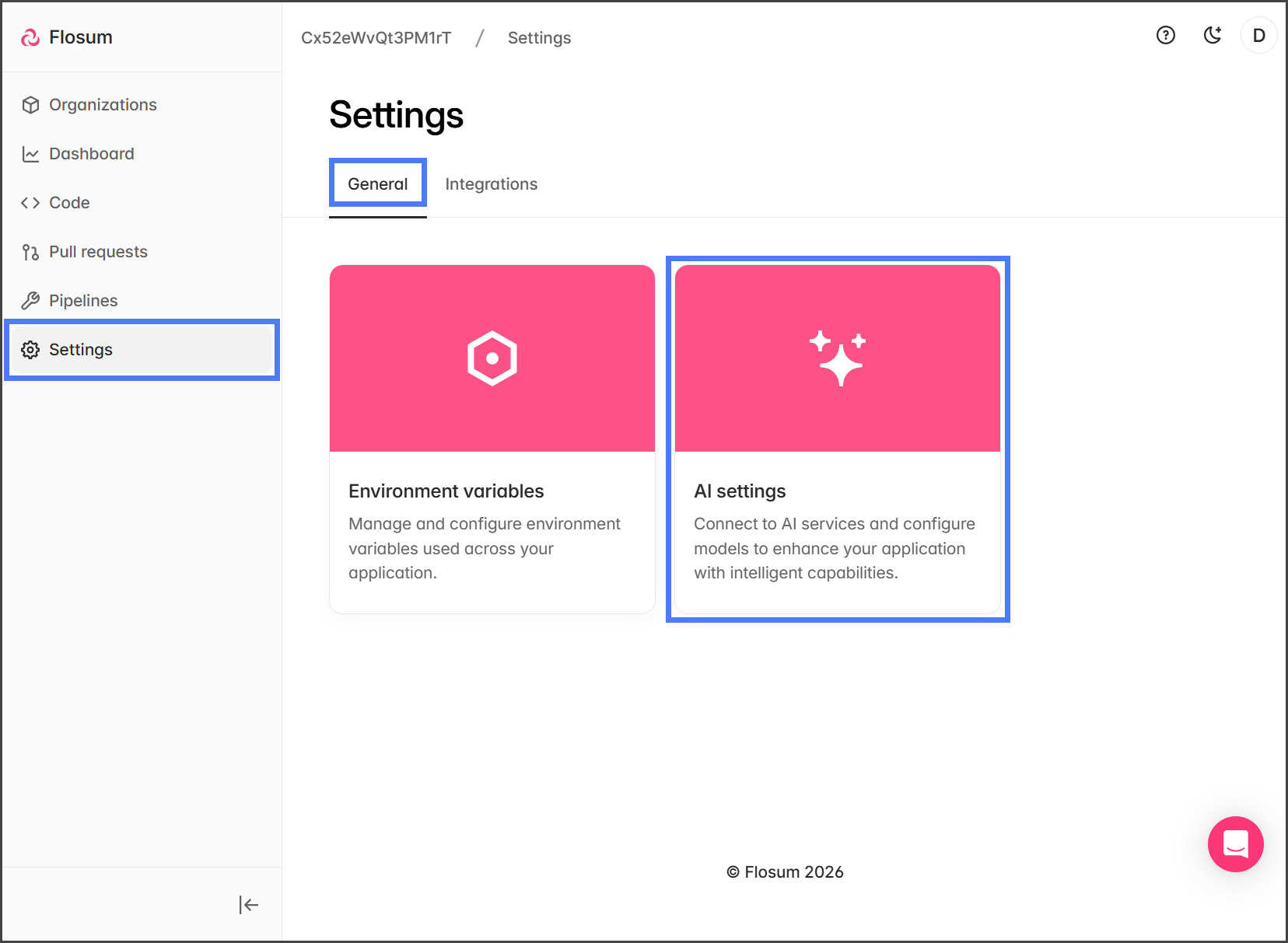

1. Klicken Sie auf **Einstellungen** im Menü der linken Seitenleiste.

2. Klicken Sie auf die **Allgemein** Registerkarte.

3. Klicken Sie auf **KI-Einstellungen**.

{% endstep %}

{% step %}

### Benutzerdefiniertes Modell aktivieren

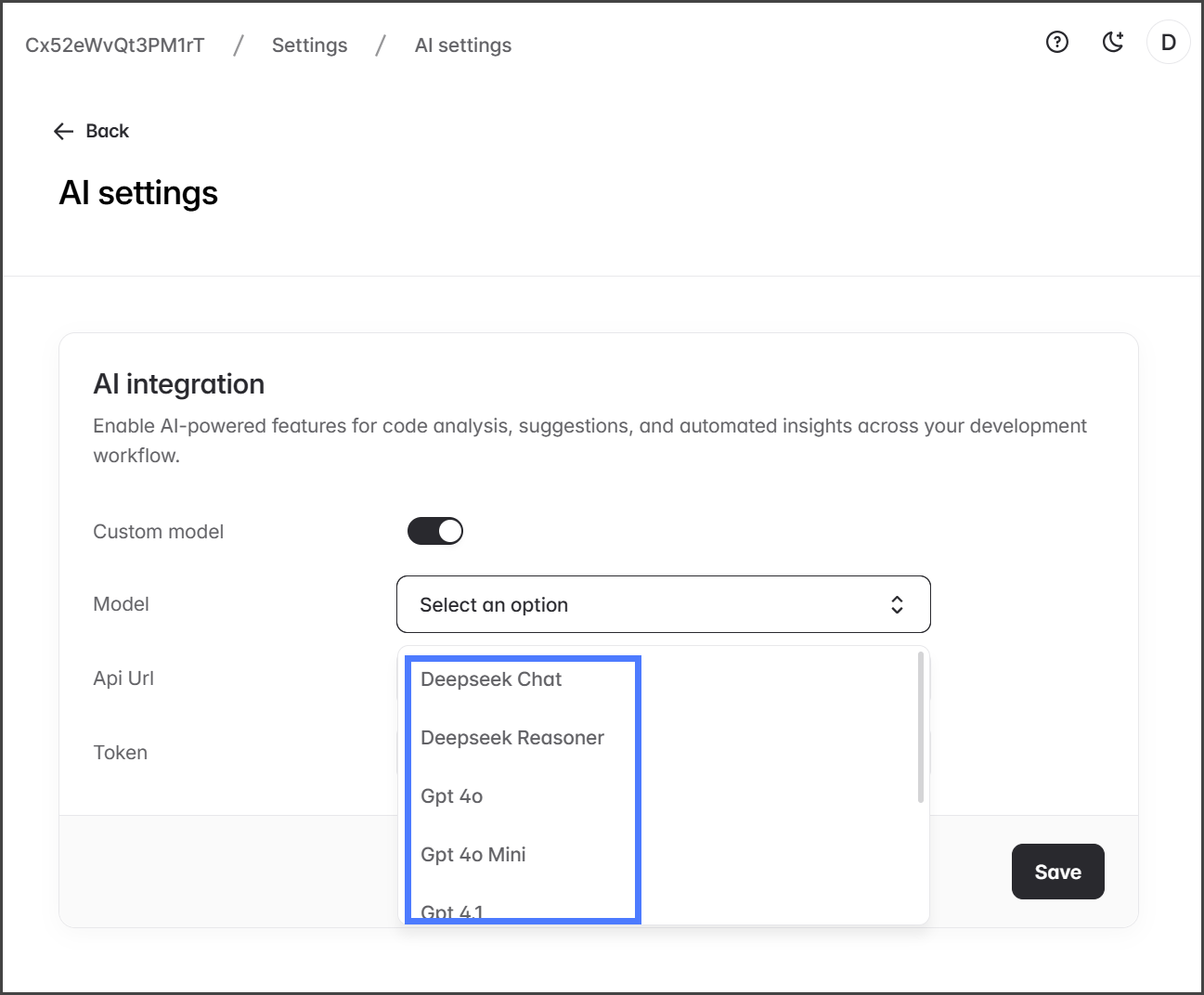

1. Aktivieren Sie den **Benutzerdefiniertes Modell** Schalter.

2. Klicken Sie auf die **Modell** Dropdown-Menü.

3. Wählen Sie das KI-Modell aus, mit dem Sie eine Verbindung herstellen.

4. Geben Sie im **API-URL** Textfeld die Endpunkt-URL des KI-Modells ein, mit dem Sie eine Verbindung herstellen.

{% hint style="info" %}

#### API-URL

**DeepSeek-API-Endpunkt**

Sie können eine Verbindung zu einem von DeepSeek gehosteten DeepSeek-Modell über die folgende URL herstellen:

*

**OpenAI-API-Endpunkt**

Sie können eine Verbindung zu einem von OpenAI gehosteten GPT-Modell über die folgende URL herstellen:

*

**API-Endpunkt eines Drittanbieters oder selbst gehosteter API-Endpunkt**

Sie können eine Verbindung zu jedem KI-Modell eines Drittanbieters oder selbst gehosteten KI-Modell herstellen, das einen mit OpenAI kompatiblen API-Endpunkt verwendet. Die API-URL muss von Flosums Servern aus erreichbar sein.

{% endhint %}

5. Geben Sie im **Token** Textfeld, geben Sie Ihr API-Token für die Verbindung mit dem KI-Modell ein.

6. Klicken Sie auf **Speichern**.

7. Wenn die Verbindung mit dem KI-Modell erfolgreich ist, wird die Meldung "**KI-Modell erfolgreich konfiguriert." angezeigt.**"

{% endstep %}

{% step %}

### KI-Funktionen verwenden

Anweisungen zur Verwendung der KI-Funktionen von DevOps finden Sie in den folgenden Artikeln:

* KI-Testklassenersteller

* KI-Code-Dokumentierer

{% endstep %}

{% endstepper %}